La curiosidad sobre el próximo gran paso de Meta está alcanzando un punto álgido en la carrera por dominar el panorama de la inteligencia artificial. Con su modelo de texto generativo Llama 2, lanzado en julio, bien establecido en el mercado, los observadores de la IA buscan ávidamente señales de Llama 3.

Si hay que creer en los murmullos de la industria, la secuela del éxito del código abierto del titán tecnológico podría llegar a principios de 2024.

Meta no ha confirmado oficialmente los rumores, pero Mark Zuckerberg recientemente arrojó algo de luz sobre lo que podría ser el futuro de los LLM (grandes modelos de lenguaje) de Meta, comenzando con un reconocimiento de que Llama 3 está en proceso. Pero, dijo, el nuevo modelo fundamental de IA todavía está en un segundo plano, mientras que la prioridad sigue siendo ajustar Llama 2 para hacerlo más amigable para el consumidor.

“Quiero decir, siempre hay otro modelo que estamos entrenando”, dijo en una entrevista de podcast que se centró en la intersección entre la IA y el metaverso, “entrenamos Llama 2 y lo lanzamos como un modelo de código abierto, y En este momento la prioridad es incorporar eso en una serie de productos de consumo…

“Pero sí, también estamos trabajando en los futuros modelos de base y no tengo nada nuevo al respecto”, continuó. “No sé exactamente cuándo estará listo”.

Si bien Meta no ha confirmado oficialmente los rumores, los patrones en los ciclos de desarrollo y las fuertes inversiones en hardware apuntan a un lanzamiento inminente. Llama 1 y Llama 2 tuvieron intervalos de entrenamiento de seis meses y, si esta cadencia se mantiene, la nueva Llama 3, que se especula que está a la par con el GPT-4 de OpenAI, podría lanzarse en la primera mitad de 2024.

Para añadir profundidad a la especulación, el usuario de Reddit llamaShill ha presentado un análisis exhaustivo de los ciclos históricos de desarrollo del modelo de Meta.

El entrenamiento de Llama 1 se extendió desde julio de 2022 hasta enero de 2023, y Llama 2 hizo lo mismo hasta julio de 2023, propuso el usuario, estableciendo un escenario plausible para el entrenamiento de Llama 3 de julio de 2023 a enero de 2024. Estos conocimientos encajan con la narrativa de un Meta que es Buscando incansablemente la excelencia en IA, ansioso por mostrar su próximo avance que podría estar hombro con hombro con las capacidades de GPT-4.

Mientras tanto, los foros tecnológicos y las redes sociales están llenos de discusiones sobre cómo esta nueva versión podría restablecer la ventaja competitiva de Meta. La comunidad tecnológica también ha elaborado una línea de tiempo probable a partir de la información disponible.

Escuchado en una red social Meta GenAI:

“Tenemos computación para entrenar a Llama 3 y 4. El plan es que Llama-3 sea tan bueno como GPT-4”.

“Vaya, si Llama-3 es tan bueno como GPT-4, ¿seguirán abriendo el código fuente?”

“Sí, lo haremos. Lo sentimos, gente de alineación”.

— jason (@agikoala) 25 de agosto de 2023

Agregue a eso un poco de herejía de Twitter: una conversación supuestamente escuchada en una red social “Meta GenAI”, luego tuiteada por el investigador de OpenAI Jason Wei. “Tenemos el cómputo para entrenar a Llama 3 y 4”, dijo una fuente no identificada, según Wei, y luego afirmó que también sería de código abierto.

Mientras tanto, la asociación de la compañía con Dell, que ofrece Llama 2 en las instalaciones para usuarios empresariales, subraya su compromiso con el control y la seguridad de los datos personales, una medida que es a la vez estratégica e indicativa de los tiempos que corren. A medida que Meta se prepara para enfrentarse cara a cara con gigantes como OpenAI y Google, este compromiso es fundamental.

Meta también está incorporando IA en muchos de sus productos, por lo que tiene sentido que la empresa aumente sus apuestas para no quedarse atrás. Llama 2 impulsa Meta AI y otros servicios como los chatbots de Meta, los servicios generativos de Meta y las gafas de IA de Meta, por nombrar algunos.

En medio de este torbellino de especulaciones, las reflexiones de Mark Zuckerberg sobre el código abierto Llama 3 sólo han servido para intrigar y desconcertar. “Necesitaríamos un proceso para agrupar esto y hacerlo seguro”, compartió Zuckerberg durante un podcast reciente con el científico informático Lex Fridman.

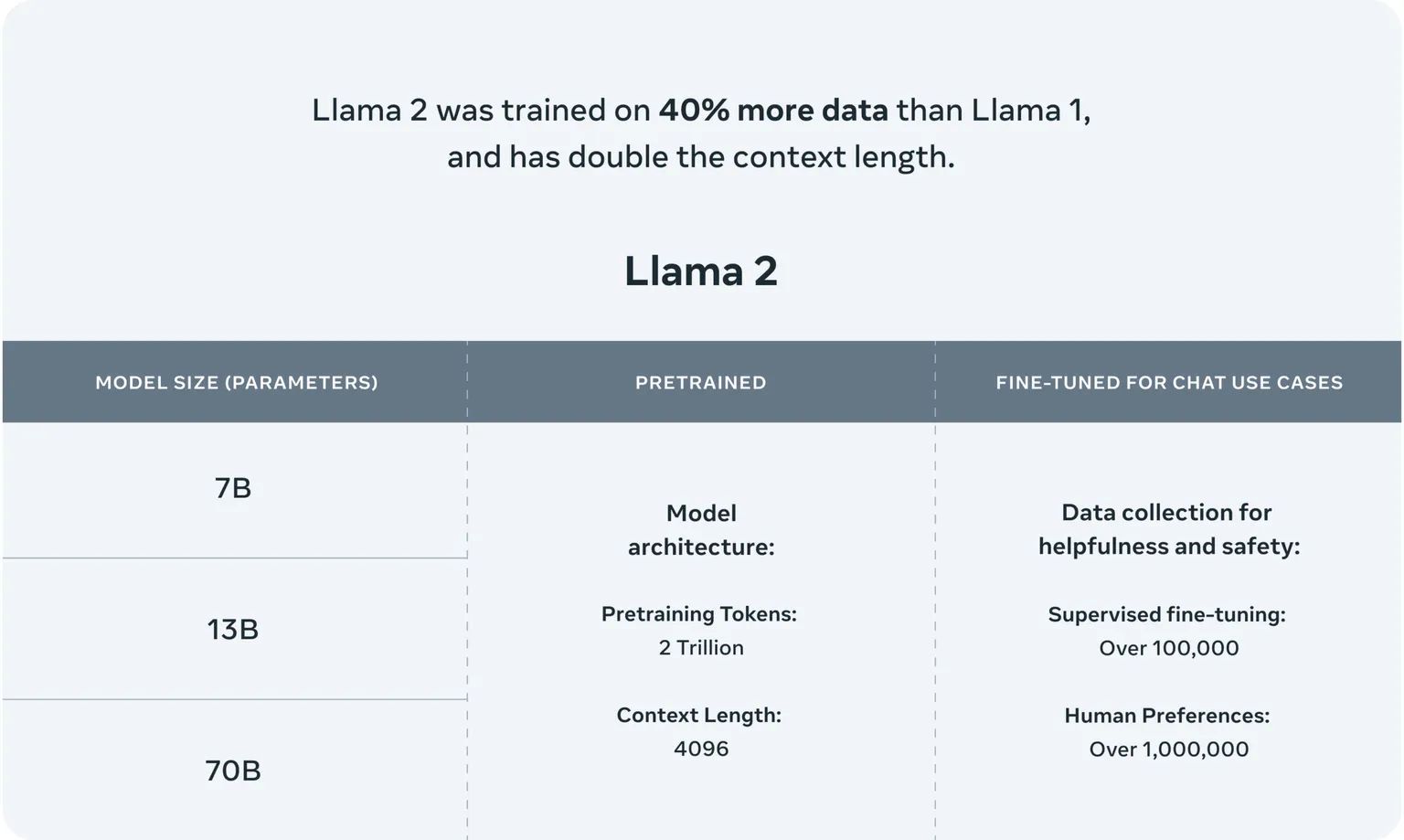

Llama 2 cuenta con una arquitectura de varios niveles con versiones que ofrecen 7 mil millones, 13 mil millones y 70 mil millones de parámetros robustos, cada uno de ellos adecuado para diferentes niveles de complejidad y potencia computacional. Los parámetros en los LLM sirven como bloques de construcción neuronales que definen la capacidad del modelo para comprender y generar lenguaje, y la cantidad de parámetros a menudo se correlaciona con la sofisticación y la calidad de salida potencial del modelo.

La potencia de la IA ha sido entrenada en un extenso corpus de 2 billones de tokens, lo que respalda su capacidad para navegar y generar texto similar a un humano en una amplia gama de temas y contextos.

Al fondo también se están sentando las bases del hardware. Según lo informado por DescifrarMeta está abasteciendo un centro de datos con Nvidia H100, una de las piezas de hardware más poderosas para el entrenamiento de IA, una clara señal de que las ruedas están en movimiento.

Sin embargo, a pesar de todo el entusiasmo y la especulación, la verdad sigue envuelta en un velo de secreto corporativo.

Las intenciones de Meta de competir en el espacio de la IA están determinadas en gran medida por los tiempos de capacitación requeridos, las inversiones en hardware y la cuestión del código abierto. Mientras tanto, la anticipación es tan palpable como probable el lanzamiento de Llama 3 en 2024.

Editado por Ryan Ozawa.