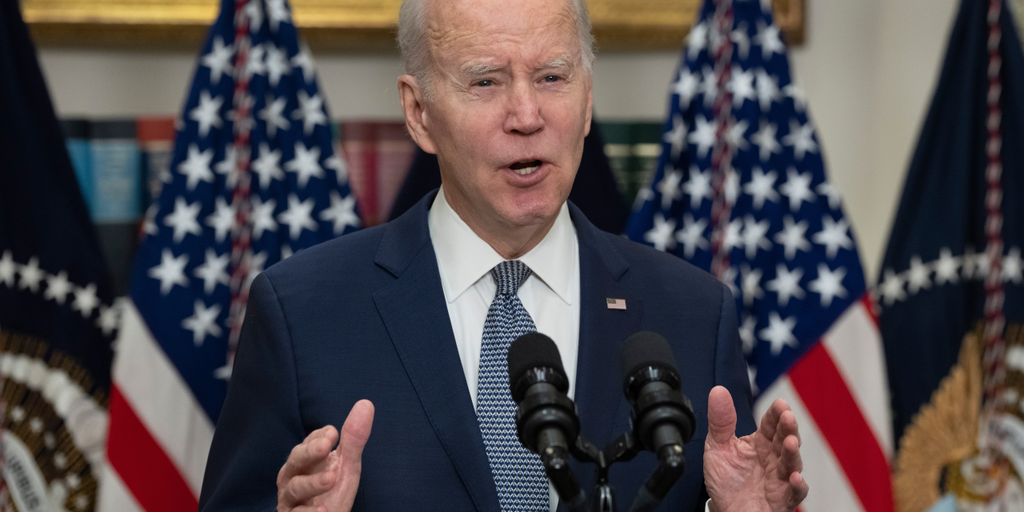

Después de que un deepfake del presidente estadounidense Joe Biden generado por IA tuviera como objetivo engañar a los votantes de las primarias de New Hampshire el mes pasado, la administración está intensificando sus esfuerzos para autenticar las comunicaciones oficiales de la Casa Blanca.

Con la caja de Pandora de la IA abierta de par en par, tanto los tecnólogos como los especialistas en ética están luchando por encontrar formas de combatir los deepfakes generados por la IA. La Casa Blanca ahora dice que está explorando el uso de tecnología criptográfica para designar contenido genuino.

“Reconocemos que una tecnología cada vez más potente hace que sea más fácil hacer cosas como clonar voces o vídeos falsos”, dijo el asesor especial de la Casa Blanca sobre IA, Ben Buchanan. Business Insider a principios de este mes. “Queremos no inhibir la creatividad que podría surgir al tener herramientas más poderosas y al mismo tiempo asegurarnos de gestionar algunos de los riesgos”.

Buchanan dijo que después de que la administración Biden se reuniera con más de una docena de desarrolladores de inteligencia artificial en 2023, las empresas acordaron incorporar marcas de agua en sus productos antes de lanzarlos al público. Sin embargo, las marcas de agua se pueden manipular y eliminar por completo, lo que hace atractivo el método inverso.

“[On] Por parte del gobierno, estamos en el proceso de desarrollar estándares de marcas de agua a través del nuevo Instituto de Seguridad de IA y el Departamento de Comercio para asegurarnos de que tenemos un conjunto claro de reglas de tránsito y orientación sobre cómo abordar algunas de estas marcas de agua y contenido espinosos, problemas de procedencia”, dijo Buchanan Yahoo Finanzas.

Un portavoz de la Casa Blanca no respondió de inmediato a una solicitud de comentarios de Descifrar.

En diciembre, en una iniciativa para combatir las imágenes generadas por IA, los gigantes de la imagen digital Nikon, Sony y Canon anunciaron una asociación para incluir una firma digital en las imágenes tomadas con sus respectivas cámaras.

La semana pasada, la Administración Biden anunció el lanzamiento del Instituto de Seguridad de la IA de EE. UU. con participantes como OpenAI, Microsoft, Google, Apple y Amazon. El Instituto, dijo la administración, nació de la orden ejecutiva de Biden dirigida a la industria de la IA en octubre.

El desarrollo de IA para detectar deepfakes se ha convertido en una industria artesanal. Sin embargo, algunos se oponen a esta práctica, diciendo que sólo empeorará el problema.

“Usar IA para detectar IA no funcionará. Más bien, crea una carrera armamentista interminable. Los malos siempre ganarán”, dijo el cofundador y director ejecutivo de la empresa de verificación de identidad IDPartner, Rod Boothby. Descifrar. “La solución es darle la vuelta al problema y permitir que las personas prueben su identidad en línea. Usar la identidad bancaria es la solución clara al problema”.

Boothby señala el uso por parte del sector bancario de la “autenticación continua” para garantizar que la persona en una sesión anónima de Internet sea quien dice ser.

Para Star Kashman, experto en ciberseguridad y derecho, protegernos de los deepfakes se remonta a la concienciación.

“Especialmente en el caso de las llamadas automáticas y las estafas telefónicas generadas por IA, crear conciencia puede evitar muchos daños”, dijo Kashman. Descifrar en un correo electrónico. “ Si su familia es informada de una estafa común por teléfono de voz con IA en la que los estafadores llaman fingiendo que secuestraron a un miembro de la familia y usan IA para imitar la voz de ese miembro de la familia, entonces la persona que recibe la llamada puede saber que debe verificar a ese familiar antes de pagar. un rescate falso para alguien que nunca estuvo desaparecido”.

Los avances en la IA generativa han hecho que sea cada vez más fácil estafar y engañar al público en general, como quedó evidenciado más recientemente en una campaña de llamadas automáticas que intentó impedir que los votantes demócratas en New Hampshire participaran en las elecciones primarias del mes pasado.

La llamada automática de Biden se rastreó hasta una empresa de telecomunicaciones con sede en Texas. Después de emitir una orden de cese y desistimiento a Lingo Telecom LLC., la Comisión Federal de Comunicaciones de EE. UU. aprobó una nueva norma que declara ilegales las llamadas automáticas que utilizan voces de IA.

Si bien Kashman dijo que la concientización sigue siendo la mejor manera de evitar ser estafado por falsificaciones de IA, reconoció que la amenaza requiere la intervención del gobierno.

“En cuanto a las falsificaciones profundas, el conocimiento no impide que las personas las creen”, dijo Kashman. “Sin embargo, el conocimiento puede agregar más presión al gobierno, que es necesaria para aprobar una legislatura que haga que la creación de falsificaciones ilícitas no consensuadas sea federalmente ilegal”.